Quelle est la température à la surface du globe ? Avec le grand nombre d’agences qui proposent une estimation de la température mondiale, on peut légitiment se demander s’il y a ou non une référence, s’il y a des raisons de privilégier une archive climatique plutôt qu’une autre.

Pour déterminer la température de notre planète, les scientifiques combinent des mesures de l’air au-dessus de la terre et de de l’océan. Les températures sont collectées par des stations météo, des navires, des bouées mais aussi des satellites.

Avant de comparer les archives, il est nécessaire de rappeler leur modes de récolte des données. On peut opérer une distinction entre trois types d’archives : les mesures de surface, les mesures par satellite et les réanalyses.

Les différents types d’archives

Les mesures de surface sont recueillies par un réseau mondial de stations météorologiques, de navires et de bouées. Ce réseau mesure la température de l’air au-dessus des terres et la température de surface de la mer.

Les données satellites ne mesurent pas directement la température à la surface du sol, mais interprètent la température de la basse troposphère (les 5 premiers kilomètres). Des sondeurs récupèrent les profils de température verticaux de l’atmosphère en mesurant l’émission thermique de molécules d’oxygène à différentes fréquences.

Les réanalyses atmosphériques utilisent une gamme d’observations plus large, notamment des données de stations météo et satellitaires combinées à un modèle de prévision météorologique, pour produire une analyse de la température globale complète.

Une tendance générale au réchauffement

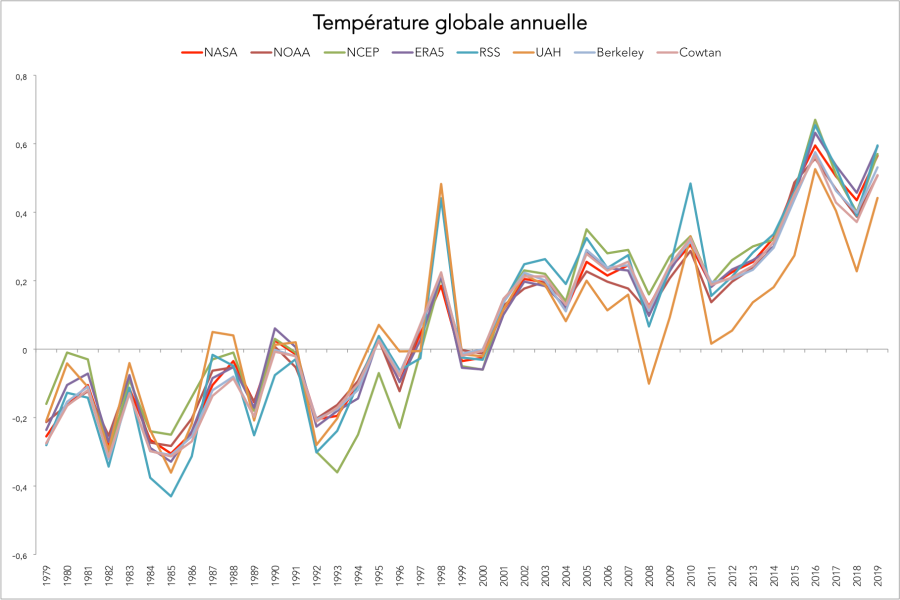

La diversité des archives de température peut susciter la confusion. Mais malgré des méthodes différentes, toutes les agences observent une élévation des températures. Ci-dessous, on peut voir un graphique présentant les mesures de température annuelle en surface (NASA, NOAA, Berkeley, Cowtan), par satellite (RSS, UAH) et les réanalyses (NCEP-NCAR, ERA5).

Malgré des modalités de mesure radicalement différentes, le réchauffement est manifeste quelle que soit l’archive et la méthode considérée. Les données UAH affichent un réchauffement moindre mais un réchauffement tout de même. On y reviendra par la suite.

Comment les mesures de surface traitent les données manquantes

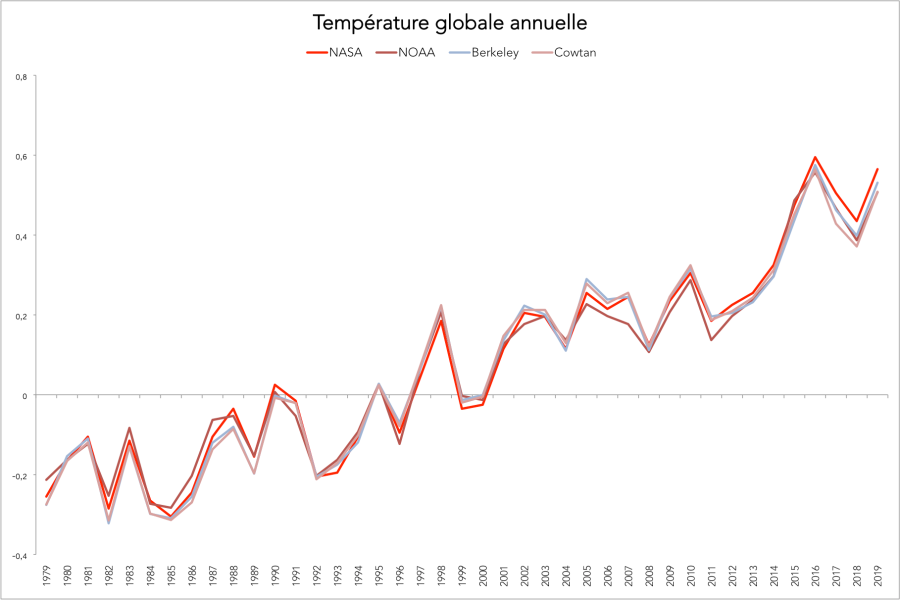

Les quatre archives que sont la NASA, la NOAA, Berkeley et Cowtan ont pour point commun d’utiliser les températures in situ, à la surface des terres et de la mer.

Des différences peuvent cependant exister quand aux méthodes employées pour combler les données manquantes. La NASA et la NOAA, les deux plus connues, sont très similaires de part les sources utilisées mais la NASA propose une couverture du globe plus complète grâce à une méthode d’interpolation, un outil statistique permettant de calculer des données manquantes grâce aux stations les plus proches. La NASA et la NOAA couvrent respectivement 99% et 93% de la planète. Le réchauffement légèrement plus important de la NASA est lié notamment à la couverture polaire plus importante. Le réchauffement de l’Arctique étant plus rapide que la moyenne, une couverture spatiale étendue vers le pôle nord aura tendance à favoriser une moyenne globale plus élevée.

Berkeley Earth et Cowtan & Way adoptent une méthode d’interpolation encore plus sophistiquée, le krigeage. Berkeley Earth utilise en outre bien plus de stations que la NASA et la NOAA qui proposent des enregistrements d’environ 5000 à 7000 stations terrestres du réseau GHCN. L’ensemble de données de Berkeley comprend quand à lui environ 39 000 enregistrements grâce à l’utilisation de bases de données supplémentaires au-delà du GHCN, via une méthodologie qui permet d’incorporer des séries temporelles courtes et fragmentées dans le modèle statistique.

Cowtan & Way utilise les données du Met Office (agence météo britannique) basées également sur GHCN avec l’addition de la méthode du krigeage qui permet d’étendre la couverture spatiale aux régions non pourvues en mesures in situ.

Malgré des différences dans l’estimation des données manquantes, l’accord entre la NOAA, la NASA, Berkeley Earth et Cowtan & Way est remarquable. On pourrait ajouter que les données du Met Office sans interpolation dans les régions sans données affichent une tendance comparable.

Les ajustements des satellites

Les satellites utilisés par RSS et UAH ne mesurent pas directement la température à la surface du sol, mais interprètent la température de la basse troposphère. Leurs mesures sont effectuées par les instruments MSU et AMSU installés sur des satellites.

Les satellites ont l’avantage de proposer une couverture uniforme mais ne sont pas des thermomètres. Les données doivent être converties en estimations des tendances de la température et présentent des incertitudes importantes.

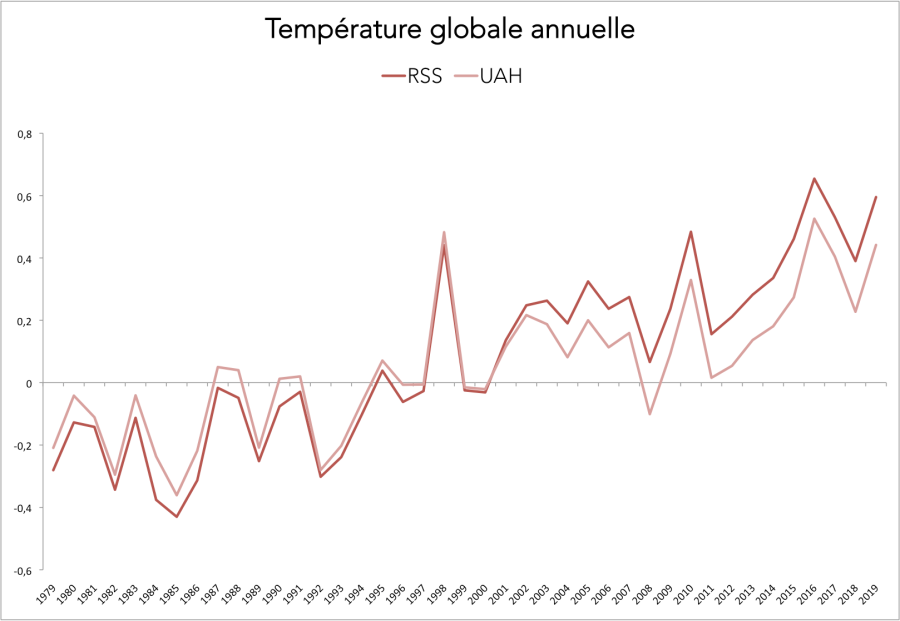

RSS et UAH utilisent les mêmes instruments mais un traitement différent conduit à des différences notables dans l’estimation de la température globale.

Un problème majeur auquel sont confrontés les satellites est lié aux modifications de l’orbite, ce que l’on appelle la «dérive diurne». Le temps d’observation local pour la plupart des satellites dérive dans le temps, ce qui affecte l’historique à long terme. Sans correction, les cycles de température quotidiens commenceront à ajouter un biais aux données. Une correction de dérive diurne est donc nécessaire pour chaque satellite. Les deux groupes – UAH et RSS – utilisent différentes méthodes pour y parvenir.

RSS adopte l’approche consistant à utiliser un modèle climatique haute résolution pour éliminer la dérive diurne. L’ajustement diurne dans la dernière version V6 d’UAH est empirique, selon Christy et Spencer, et calculée en comparant un engin spatial à dérive diurne à un autre qui ne dérive pas pendant la période de comparaison.

Peut-on dire qu’une méthode est plus objective qu’une autre ?

Les ajustements des données satellitaires font naître des divergences importantes entre RSS et UAH quand à la tendance.

Si maintenant, on ne retient que les mesures de surface, l’homogénéité des séries est indéniable.

Les données des différentes agences proposant des mesures in situ, comme la NASA, la NOAA ou Berkeley Earth sont donc plus proches les unes des autres que ne le sont celles des satellites.

Contrairement à ce qui peut être avancé par certains, les mesures par satellite ne sont pas plus objectives que celles issues des stations au sol, si par objectif on entend « sans ajustement ». C’est même plutôt l’inverse.

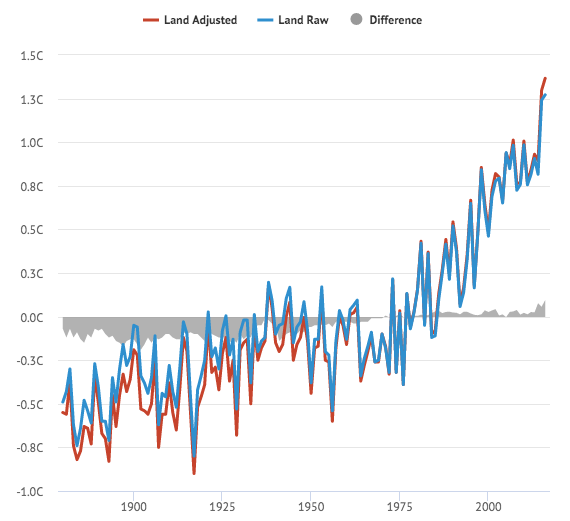

En effet, les données brutes à la surface des terres différent peu des températures ajustées. Des ajustements sont certes nécessaires car la collecte peut être affectée (changements de lieu, de matériel, d’heure de mesure, d’environnement). Mais quand on compare les séries brutes (raw data en anglais) aux séries ajustées de la NOAA, la différence est minime à la surface des terres, surtout sur la période récente.

Si l’on considère la température globale, avec l’ajout de la température à la surface des mers, les données brutes montrent même un réchauffement plus important. Ces ajustements sont surtout antérieurs à 1950 et presque entièrement dus à des changements dans la façon dont les navires mesuraient les températures.

Autre argument parfois entendu pour invalider les relevés in situ, celui de l’îlot de chaleur urbain. Ce phénomène est certes bien réel, reflétant le réchauffement plus important en ville qu’aux alentours. Mais il n’affecte pas la mesure de la température globale. Pour corriger un éventuel biais, la NASA identifie les stations urbaines en utilisant des mesures satellites de la luminosité nocturne. Leur tendance ajustée correspond à un enregistrement composite réalisé à partir de stations rurales voisines. Les stations qui ne bénéficient pas d’un soutien suffisant des stations rurales sont abandonnées. Cet ajustement a produit sur les chiffres de la NASA une réduction du réchauffement de 0,01°C sur la période 1900-2009.

Par ailleurs, une étude poussée de Berkeley Earth sur l’îlot de chaleur urbain a montré que son influence sur la température globale était minime. Il faut signaler que Berkeley Earth a été créé par Richard Muller, qui se présente lui-même comme un « sceptique converti ». Mettant initialement en doute l’existence même du réchauffement climatique, Richard Muller a décidé d’impulser un effort de recherche intensif impliquant une dizaine de scientifiques pour vérifier les données des principales agences. Au final, les recherches lancées ont conclu que le réchauffement climatique était réel et que les estimations antérieures du taux de réchauffement étaient correctes.

Muller a d’abord cherché à enquêter sur les affirmations des sceptiques selon lesquelles des données et des méthodes défectueuses avaient faussé les examens antérieurs des tendances de la température mondiale. Les recherches ont été initialement financées par le milliardaire pétrolier Charles Koch qui a soutenu les efforts contre la science traditionnelle du changement climatique. Berkeley Earth a relevé la même tendance au réchauffement que la NASA. On peut donc difficilement l’accuser de parti-pris.

Des mesures affectées par des phénomènes climatiques

Il faut aussi préciser que les données satellitaires surestiment les phénomènes El Niño par rapport aux relevés au sol de la NASA, de la NOAA ou du Met Office. D’après Kevin Trenberth (chercheur au NCAR), El Niño répand la chaleur dans la troposphère, là où les satellites effectuent leurs mesures, alors que des poches froides ici ou là affectent les températures de surface de la mer utilisées par la NASA ou la NOAA.

Une autre différence est avancée par Carl Mears, le directeur de RSS : El Niño amplifie le réchauffement de surface en raison du gradient vertical adiabatique humide (la vitesse à laquelle une parcelle d’air saturée se refroidit lorsqu’elle se déplace verticalement) . Dans la moyenne à haute troposphère, les événements El Niño entraînent des changements de température plus importants que dans la troposphère inférieure car le réchauffement à la surface sous les tropiques est amplifié à plus haute altitude en raison du gradient vertical adiabatique humide.

Étant donné que les satellites ne mesurent techniquement pas la température à la surface (où vivent les gens), la NASA estime qu’il est prudent de dire que les thermomètres au sol sont plus précis que les mesures par satellite.

Comparer les tendances et la corrélation entre les archives

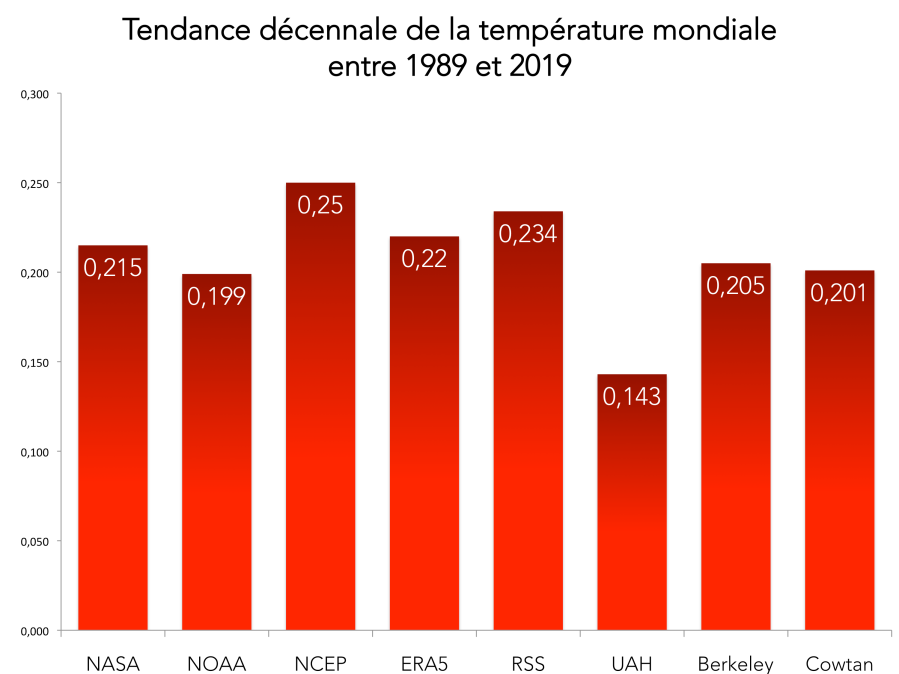

Sur la période 1989-2019, le réchauffement moyen des huit archives (NASA, NOAA, NCEP, ERA5, RSS, UAH, Berkeley Earth, Cowtan) est de 0,21°C par décennie (soit 0,021°C par an ou 2,1°C par siècle). NCEP-NCAR et RSS affichent les tendances les plus élevées avec respectivement +0,25°C et +0,234°C. UAH est nettement sous la moyenne avec +0,143°C.

On notera que les deux données satellitaires RSS et UAH sont très éloignées l’une de l’autre pour ce qui est de la tendance. Les relevés de surface (NASA, NOAA, Berkeley et Cowtan) sont en revanche très proches.

Les deux archives qui affichent la tendance la plus proche de la moyenne sont Berkeley Earth et la NASA.

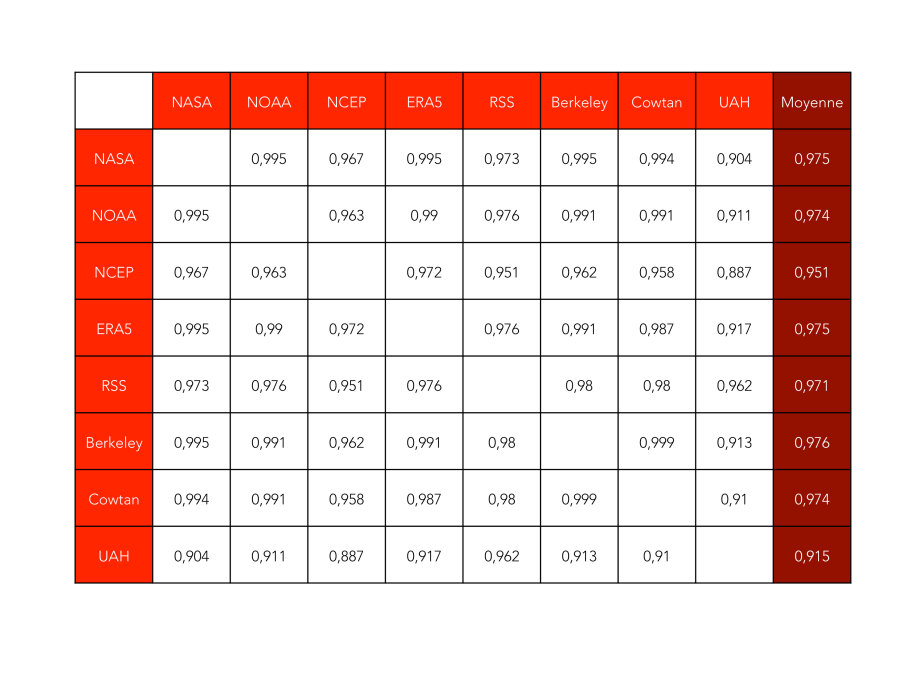

La corrélation entre les séries de données est résumée dans le tableau ci-dessous pour la période 1979-2019. Une valeur de 1 indique une corrélation positive parfaite. Plus la valeur se rapproche de 0, moins la corrélation entre deux séries est forte.

Le tableau des corrélations montre une grande proximité entre les variations de la NASA, de la NOAA, de Berkeley, de Cowtan et de ERA5. A l’inverse, UAH fait une nouvelle fois figure d’outsider. De manière surprenante, RSS, qui utilise pourtant les mêmes instruments qu’UAH, est davantage corrélée à Berkeley.

Une fois de plus, Berkeley Earth et la NASA se distinguent, affichant les coefficients de corrélation les plus élevés, juste devant ERA5, Cowtan et la NOAA.

Au final, La réanalyse ERA5 apparaît comme plus proche de la moyenne des archives que NCEP-NCAR, que cela soit pour la tendance ou le coefficient de corrélation. Pas de grosse surprise, puisque NCEP-NCAR est un outil de première génération (1996). ERA5 est une réanalyse de dernière génération qui propose une résolution horizontale, verticale et temporelle supérieure. Depuis fin 2019, NCEP-NCAR affiche un biais froid et a présenté des anomalies surprenantes, notamment cet été en Sibérie, où il y a eu manifestement une sous-estimation des températures.

RSS est plus proche des températures de surface et des réanalyses qu’UAH. Cela ne plaide pas en faveur d’UAH, surtout quand on sait que les données satellitaires sont soumises à des difficultés de calibrage.

Quand aux mesures de surface, elle sont assez homogènes, avec une mention spéciale pour Berkeley et la NASA.

Catégories :Climat

Merci pour le travail accompli.

J’aimeJ’aime

Merci Parmantier.

J’aimeJ’aime

Remarquable synthèse .d’un ensemble de travaux difficilement accessibles..

J’aimeJ’aime

Merci, il y a beaucoup de données qui circulent et il n’est pas toujours facile d’y voir clair.

J’aimeJ’aime

+0,6°C en trente ans, et +1,2°C par rapport à l’ère préindustrielle: il n’y a pas besoin d’être un génie pour comprendre que l’objectif des +1,5°C ne sera pas tenu. En fait, au rythme où on va, il est beaucoup plus réaliste de se fier au RCP 8,5 pour savoir ce qui nous attend.

J’aimeJ’aime

Sous réserve qu’il n’y ait globalement pas d’accélération sur la période, ce qui est loin d’être évident. Si on était/restait en régime linéaire, 1.2+80/30*0.6=2.8°C en 2100, c’est plutôt éloigné du RCP8.5.

J’aimeJ’aime

C’est toute l’interrogation: va-t-il y avoir accélération? La vitesse du réchauffement a déjà doublé au cours des 40 dernières années par rapport à la vitesse moyenne du XXème siècle. Si ça double encore ces prochaines décennies, comme prévu par les modèles repris dans le GIEC (sous réserve d’un scénario « business as usal », mais j’ai peu de doutes là-dessus), on sera plutôt autour des 5°C d’ici la fin du siècle.

J’aimeJ’aime

Car la hausse actuelle est liée au forçage en cours et celui-ci serait plus important avec le RCP 8.5 qui prévoit plus d’émissions de CO2.

Ceci dit, la fourchette haute du RCP 6.0 nous amène vers les 4°C.

J’aimeJ’aime

Merci Johan pour ce remarquable article. Pourquoi ne pas avoir rappelé le climato-scepticisme affiché publiquement de Christy et Spencer ? J’ai du mal à comprendre pourquoi la réanalyse UAH est conservée dans les séries de référence.

J’aimeJ’aime

Merci Goupil, vous faites bien de mentionner le climatoscepticisme des 2 compères d’UAH. Spencer et Christie sont proches des milieux conservateurs américains qui contestent le rôle de l’homme dans le Réchauffement climatique.

Ils ont surtout été à plusieurs reprises désavoués pour leur erreurs techniques avec UAH, allant dans le sens d’un refroidissement bien sûr.

UAH est quand même avec RSS l’archive la plus citée pour les satellites. La question se pose de sa pertinence… Mais rassurez-vous, on a suffisamment de données qui montrent qu’UAH est sans doute dans l’erreur.

J’aimeJ’aime

La température moyenne n est pas une mesure mais une extrapolation qui n à aucun sens en pratique étant donné la variété des types climatiques et des microclimats locaux que vivent les gens.Il faudra aussi que l on m explique ce qui a fait fondre la banquise qui arrivait en Belgique au pré néolithique,certainement pas l activité humaine.

Le rôle de l activité solaire est fondamental comme celle des volcans. et des courants marins profonds très mal connus.

J’aimeJ’aime

«Le rôle de l activité solaire est fondamental comme celle des volcans. et des courants marins profonds très mal connus.»

Oui, mais ça c’était avant. 🙂

Une partie de la grande arrogance de la civilisation occidentale dominante aujourd’hui consiste à affirmer qu’elle n’a que peu voire pas d’impact sur son environnement; et surtout pas ceux qui lui seraient imputable sans l’ombre d’un doute. Une belle histoire ou un écran de fumée doit être mis en place à moindre frais. Une de ses réussites en ce sens, c’est de produire un nombre fou d’évangélistes pour caractériser et relayer tout cela : régulièrement un indidvidu use aisément du sophisme naturaliste sur ce site en guise d’introduction, et ensuite toute la panoplie du négateur va y être déployée lorsque tout lui a été répété.

Souhaitez-vous poursuivre ou pensez vous que vous avez quelque chose d’ultra révolutionnaire à présenter (et ici ce n’est pas l’antichambre des membres francophone qui complotent avec le giec, merci de suivre le processus normal de publication scientifique) ?

https://global-climat.com/2021/05/05/temperature-mondiale-bilan-dera5-pour-avril-2021/

https://global-climat.com/2021/02/16/un-rechauffement-de-23c-deja-engage-dapres-une-nouvelle-etude/

J’aimeJ’aime